協作式免疫系統

從數位審議到精準立法

自由民主黨的各位議員先進、鈴木健先生、各位貴賓,大家早安,我是🇹🇼臺灣數位治理大使唐鳳。

今天,我想分享臺灣在應對 AI 詐騙(包含深偽技術 deepfakes)時,所獲得的實務經驗。

在民主社會中,我深信最重要的防詐技術不是過濾器,而是「正當性」(legitimacy)。

正如我們剛才所聽到的,生成式 AI 讓冒充詐騙變得極其廉價、極其快速,而且極具說服力。

我們都看過那些利用受信任公眾人物製作的深偽廣告。在臺灣,NVIDIA 執行長黃仁勳的影像,曾經頻繁出現在我們的 Facebook 動態牆上,推銷假的投資計畫,或是聲稱要免費發送加密貨幣。

去年,我們面臨了兩難:我們要如何阻止這些詐騙,而不掉入威權審查的陷阱?因為就像日本一樣,我們珍視網路自由。我們不希望國家進行言論審查。

臺灣的答案是:由公民協作制定的規則,轉化為精準的法律義務。

85% 的共識

正如各位所熟知的,我主張開放政府,比如起草法律不是關起門來寫字,而是從「廣泛傾聽」開始(稍後鈴木健先生將補充)。

2024 年 3 月,數位發展部(moda)召集了由 447 位公民組成的「對齊大會」,這些公民在統計學上能夠代表臺灣的人口結構。我們針對平台責任這個非常困難的問題,邀請大家集思廣益。

經過一天的視訊審議,他們給出了結果——這是一個任何遊說團體都無法反駁的民意基礎:

- 89% 支持要求平台必須偵測並標示 AI 生成內容。

- 85% 支持平台連帶責任——如果平台不配合下架詐騙廣告,導致有人誤信,平台應該對損害負連帶賠償責任。

- 關於執法:公民們同意,如果境外平台持續拒絕配合,我們應該降低其連線速度,也就是流量管制。

以上共識成為了我們立法的基礎。去年在法律通過時,沒有引起公眾的反彈,因為這些規則本就是大眾共同制定的。

新的防詐法制

有了這份正當性,我們在 2024 年 5 月提出草案,立法院 7 月通過了「打詐新四法」。其中的核心是《詐欺犯罪危害防制條例》。

今天,我將聚焦在第三章:第 27 條到第 42 條,專門規範「網路廣告平台」。注意,不是一般的言論平台,而是僅針對廣告平台。

我們將人民的道德期待,轉化為四道法律防線。

1. 源頭驗證

(第 30 條)

第一道防線是改變「預設值」。

根據第 30 條,平台必須實施 KYA(Know Your Advertiser,認識你的廣告客戶)——就像金融業的 KYC,但這是針對廣告商。

在任何廣告刊登之前——不只是投資廣告,是任何廣告——平台必須使用數位簽章、生物辨識或同等技術來驗證廣告主的身分。

如果平台無法驗證身分,就不能收廣告主的錢。就這麼簡單。

2. 徹底透明

(第 31 條)

第二道防線是打開黑盒子。

一旦身分確認,所有廣告都必須向所有觀看者清楚標示:

- 委託刊播者的姓名

- 出資購買廣告的人是誰

- 如果使用了深偽技術或 AI 生成來描繪某人,必須明確揭露

我們正在剝去詐騙集團賴以生存的匿名面紗。

3. 通知機制

(第 32 條)

第三道防線是最積極的行動。

第 32 條規定了「通知即下架」機制。如果平台知悉或被通知有詐騙內容,必須在 24 小時內將其下架。

但沒有後果的規則只是建議。

因此,第 32 條包含了一個強大的槓桿:連帶賠償責任。

如果平台在接獲通知後未能移除詐騙廣告,導致公民遭受財產損失,平台必須與詐騙者共同負擔損害賠償責任。

這在一夜之間翻轉了平台的投資報酬率(ROI)計算。合規變得比疏忽更便宜。

相對地,根據第 38 條,我們提供避風港條款。如果平台基於我們的法律善意移除內容但發生錯誤,他們可以免除對用戶的損害賠償責任。

我們懲罰不合規,但明確保護合作行為。

再次強調,這僅適用於廣告——也就是付費推播的內容。這是關於觸及率(Reach),而非言論自由(Freedom of Speech)。

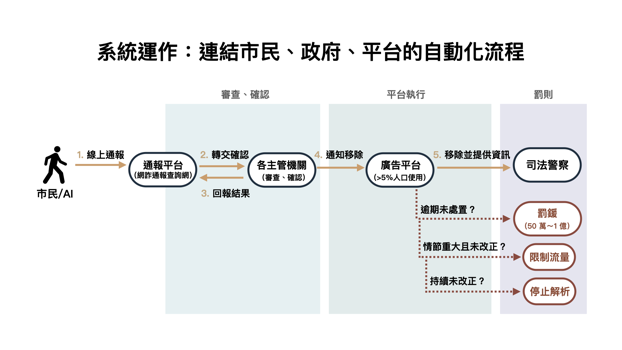

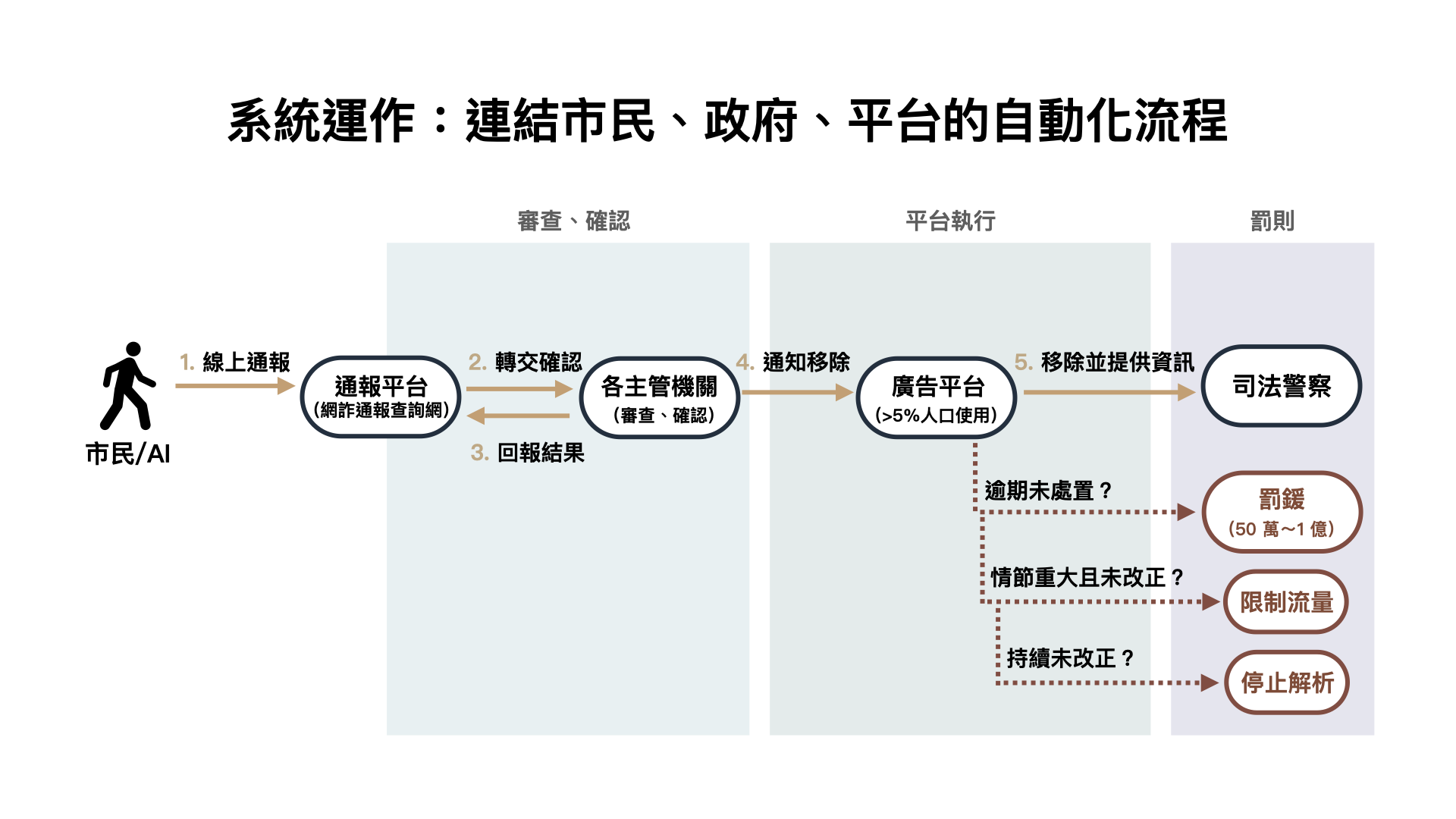

這在實務上如何運作?這是自動化的流程,連結了公民、政府和平台。

請大家注意這張圖的左側。這裡的公民不是被動的受害者,而是主動的參與者。

公民在平台上看到任何詐騙廣告,都可以在我們的《網詐通報查詢網》(Fraud Buster)上通報。

我們也訓練 AI 模型來偵測常見模式。公民標記新型態的詐騙後,一旦該類型被確認為詐騙,AI 就會接手進行自動偵測。

這些通報會透過查詢網流向各個部會:

- 投資詐騙 → 金管會

- 醫藥詐騙 → 衛福部

- 以此類推

有時,如果有人被冒充,通報網會發電子郵件給當事人:「你有授權這個影像嗎?」因為有時候人們也會建立自己的個人品牌——我們不想誤刪那些內容。如果他們說:「這些是我的,其他都不是」,那我們就知道該針對什麼。

一旦主管機關確認這確實是詐騙,就會發送給平台。通知發出後開始計時,平台必須在 24 小時內下架。

最後防線:執法

(第 39 條)

如果跨國巨頭拒絕配合怎麼辦?

第 29 條要求平台必須在臺灣指定法律代理人。不再接受「我們沒有在地辦公室」這種藉口。

如果他們仍然拒絕配合,第 39 條授權我們的專家審議委員會執行公民授權的處罰:

- 高額罰款:每次違規最高可達新台幣 1 億元。

- 流量管制:我們可以命令網際網路服務供應商(ISP)降低對該平台的存取速度。這會降低使用者體驗,讓平台在商業廣告上無利可圖,但言論自由依然受到保障。

- 限制接取:如果持續未改正,最後可以對平台網域停止解析。

結果:信任的重建

這套系統有效嗎?數據會說話。數位發展部的報告顯示:

- 名人冒充詐騙廣告下降了 超過 95%。

- 投資詐騙廣告下降了 近 90%。

我們的 AI 主動掃描,顯示這對日常生活的意義:名人冒充詐騙廣告的數量,從 2024 年 5 月的 每週超過 30,000 則,在法律生效後崩跌至 每週低於 1,000 則,現在已經非常罕見。

在公共安全成果方面,從 2024 年 11 月到 2025 年 11 月:

- 受理詐欺案件數下降了 25%。

- 公民通報的財損金額下降了 超過 50%。

這是指所有案件——不僅僅是投資詐騙或廣告詐騙。

像 Meta 這樣的大型平台,已經從原本忽視我們的對立面轉變為盟友,將他們的系統與通報網整合。對抗這場詐騙病毒的抗體,是集體防護。當公民通報時,系統現在能做出回應並大規模地放大防禦效果。

從 2024 年 8 月到 2025 年 11 月,Meta 上共有 112,054 則疑似詐騙廣告被標記(由 AI 或人工)並透過合作管道下架。去年三月曾經充斥 Facebook 的假投資廣告,現在已難得一見。

以 AI 治 AI

根據 V-Dem,臺灣在過去 12 年來一直是全球境外干預攻擊的首要目標。通常,其他國家需要付費進行滲透測試——我們則是免費享有。

為什麼攻擊者能源源不絕提供這種「服務」?因為現在大多數攻擊都是 AI 協力的,對人力的消耗有限。過去,機器人生成的詐騙看起來很假,不像真人。但從去年開始,它們通過了所謂的圖靈測試——人們無法分辨機器生成和人類生成內容的差異。

不可能用人類防禦者來戰勝攻擊者的 AI,必須要以 AI 治 AI。

未來的人類,仍然會擔任 AI 防禦者的訓練師,但實際進行防禦的將是 AI 系統。

我目前擔任 ROOST(Robust Open Online Safety Tools)的董事。這個組織與 OpenAI、Discord、Bluesky 等合作,提供可以給出引用的 gpt-oss-safeguard 模型:「我們對此採取行動,是因為它違反了這條規則。」

這個 AI 模型是:

- 審慎的(Deliberative):它會思考規則。

- 開放的(Open):你可以根據在地文化進行微調。

- 可駕馭的(Steerable):人們可以共同編寫規則——這只是一個文字檔,你不需要 GPU 來重新訓練。

你只需要更改規則,它就會自動執行規則。

結語

我們學到,要在數位時代進行治理,我們不需要在自由與安全之間做選擇。

透過結合公民審議凝聚意志,與精準立法執行意志——有志者,事竟成。

我們建立了讓全球巨頭尊重、公民相互協力的系統。

這不僅僅是臺灣模式。我認為這是全球開放社會的藍圖。

日本擁有進一步演化這個模式的力量。日本擁有深厚的法治傳統。結合臺灣靈活的社會實踐,我深信我們可以攜手共創無限未來。

謝謝大家。